Skynet es el nombre que recibe la inteligencia artificial que lidera al ejército de las máquinas en la saga de películas Terminator y el principal antagonista de esta. En la saga, Skynet es una Inteligencia artificial capaz de controlar el arsenal militar de los Estados Unidos con independencia de los humanos. [Referencia]

Normalmente no me pongo tan apocalíptico pero luego de ver el poder actual de procesamiento al que tenemos acceso y la evolución que ha tenido en los últimos años si da un poquito de emoción y miedo el no saber frente a que nos encontramos.

Hemos visto en los últimos 30 años mucho más avances tecnológicos que en los 30 años anteriores. Si nos ponemos a pensar que las computadoras personales y el internet apenas aparecieron en los hogares entre 1980 y 1990, vivimos una ola de desarrollos tecnológicos que no tiene precedentes. Y menciono a computadoras e internet porque es a lo que tengo acceso pero en el sector de la investigación:

«El Sunway TaihuLight encabeza el ranking de supercomputadoras con una potencia brutal que supera los 93 petaFLOPS y ha supuesto una revolución en China porque ha sido diseñado y fabricado con procesadores de cosecha propia en el centro de supercomputación nacional». [Referencia]

Hubo ya, una predicción que se cumple aún en estos días, en 1964 Arthur L. Samuel, del Centro de Investigación Watson de IBM escribió en una serie de artículos llamados «El mundo en 1984», un artículo titulado «The Banishment of Paper Work»:

«Aunque será completamente posible obtener una educación en casa, a través del propio computador personal, la naturaleza humana no habrá cambiado, y todavía habrá necesidad de escuelas con laboratorios, aulas y profesores que motiven a los alumnos». [Referencia]

La idea de un Skynet, fuera de que sea ciencia ficción es realmente alcanzable. Los equipos de computo y su poder de procesamiento están a unos cuantos años de lograr niveles jamás antes vistos de Inteligencia Artificial (IA).

Ya vemos como normal que la IA más básica nos puede llevar por la mejor ruta, nos puede recomendar películas y series, nos hace listas de reproducción o nos pone anuncios de cosas que no sabíamos que necesitamos.

Estamos en una transición de esos usos domesticos de IA a algo que en las manos equivocadas podrían llevarnos a ese futuro apocalíptico que vimos en las películas.

Cuando veo que hay quien está usando la IA para predecir quien ganará la Copa del Mundo en lugar de aprovechar ese procesamiento en algo realmente útil, me da miedo, mucho miedo. Mucho más cuando las predicciones son erróneas.

Artificial Intelligence is a difficult concept for anyone to grasp because of all the speculation behind it. We cannot fully predict where AI will take us, since part of the theory establishes that once computers gain artificial super-intelligence, their understanding of all concepts through their ability of self-learning and self-improvement will take them further than any human brain will ever be able to comprehend.

AI responds to the development of computer systems that can execute different tasks that normally would require intelligence only human brains can process. AI is divided into three steps: Artificial Narrow Intelligence (ANI) where computers focus on one task or field of specialization such as: chess playing (here is where we stand at the moment); Artificial General Intelligence (AGI) where a computer reaches human-brain broadness of intelligence and has the ability and general capacity to work in different fields and more importantly, self-improve from its experience; and Artificial Superintelligence (ASI), the point where computers surpass human intellect. This last step is where Singularity happens, and according to scientists and people in the AI field, as soon as we hit the AGI step, ASI could be a matter of a few years straight after (or less).

We have reached ANI and we see it every day through machine learning in ads on Facebook and Instagram, financial tools predicting how markets are reacting around the globe, or on our phones with the name of Siri. This first step seems harmless and under control. But what about the next two steps? Where teams of AI experts are putting all their efforts to arrive.

On the one side, we are trying to create super-intelligent computers, but on the other side we haven’t yet fully understood the depths of the human brain, we haven’t discovered most of what lies in the depths of the ocean, and we barely know about the universe and all its galactic bodies and forces. And although some of these questions seem to be part of WHY humans are so keen on achieving artificial super-intelligence on computers, it also seems like we are trying to reach something that would be extremely difficult to handle. By reaching ASI, we are hoping to answer all the world’s unanswered questions, and even defy nature by altering the pace of evolution and playing with humanity’s biggest truth: everyone and everything dies.

At a first glance, ASI seems great: answering every question, resolving any problem. But what about human purpose in life? All of our beliefs would be ripped apart in a few years, how could humans possibly adapt to such changes where concepts like: religion and mortality, no longer exist. Where would our purpose lie? If religion is overthrown by a computer and death doesn’t exist- why would humans want to keep living? What about being good? And what about working for a better world? If all of this is no longer relevant, then why exist at all? If every problem is solved, then there would no longer be inequality, racism, poverty, disease. Any job done today, could be done by a computer. What would humans strive for? Don’t we need some sort of order to keep us motivated into living every day?

La inteligencia artificial es un término que hemos escuchado en los últimos años, sin embargo pocos saben lo que realmente es y solo se dice que es algo del futuro que está relacionado con la tecnología.

Este artículo está escrito con el fin de brindar un conocimiento básico, de que es la inteligencia artificial, en donde está y cómo puede impactar en nuestras vidas con diferentes ejemplos.

¿Qué es la inteligencia artificial (IA)?

Un concepto bastante básico que a su vez puede ser muy complejo, pero en pocas palabras la inteligencia artificial es que las máquinas piensen como humanos. Y cuando decimos eso suena raro y un poco imposible, más si partimos de la base que el cerebro tiene la red más compleja y el sistema más poderoso en la tierra.

Hoy usamos muchas tecnologías que tienen elementos de inteligencia artificial. La IA tiene la capacidad de analizar datos, identificar patrones y tendencias y con esto lanzar predicciones. ¿Donde hemos visto esto? algunos ejemplos:

- Waze: optimiza rutas en tiempo real.

- Mail: Spam ( mails que no te interesan o pueden ser dañinos).

- Spotify: por medio de gustos, te recomienda nuevas canciones.

- Facebook: recomendación de etiquetado por detección de rasgos faciales.

En realidad hay muchos pronósticos de lo que puede suceder con la IA en algunos años y como nos puede ir desplazando como humanos. Algunos ejemplos en diferentes ámbitos:

- En 30 años se espera que el 90% de los artículos de noticias van a ser escritos por máquinas.

- En la medicina, se esperan muchos avances y mejoras y 2 ejemplos puntuales son:

- Informes de cáncer de mama, el diagnóstico es realmente complejo.

- Análisis de retina, para analizar diabetes, que esto ya se hace en la actualidad, pero con estos análisis descubrieron que nos pueden dar información para otras patologías.

- En 10 años el Google Car va estar conviviendo en el 80% de las grandes ciudades, cualquier persona podría ser acreedora de un auto como este.

Se pensaba que la diferencia entre una máquina de inteligencia artificial y un humano es que la máquina no podía tener ideas o ser creativo, hoy hay una empresa llamada Vicarious que está desarrollando máquinas que simulan las conexiones neuronales que tiene el cerebro para poder dar como resultado creatividad. Fundadores de empresas como Facebook, Tesla, Skype, Yahoo, Amazon, etc están invirtiendo en esta empresa por el futuro prometedor que está tecnología podría traer y el sentido cognitivo que va a dar a las máquinas.

Hay un estudio de Oxford que dice que entre los próximos 10-20 años el 50% de los trabajos van a ser obsoletos con seres humanos.

Podemos hablar de muchos ejemplos en diferentes ámbitos y en realidad es aterrador lo que la inteligencia artificial puede transformar el mundo, hoy no se sabe con certeza si es algo positivo o negativo para el ser humano. Lo que que es importante es entender que la IA es un campo verdaderamente amplio, que va a impactar prácticamente todas las industrias y va a revolucionar la forma en la que se ha trabajado hoy en día. Nosotros como personas tenemos que encontrar una solución para subirnos a este barco y no nos quedemos atrás ya que con los avances que hoy se tienen es muy probable que la IA va a llegue a su objetivo final que es pensar como humano y si esto pasa nosotros tenemos que tener un plan.

One of the first things I have come to realize while researching Artificial Intelligence (AI) is the difficulty to define it. That is why I would like to delve a bit deeper into the basics so both the reader and I can be on the same page.

According to the Wikipedia, AI is intelligence demonstrated by the machines, in contrast to the natural intelligence displayed by humans and many animals. A typical AI perceives its environment and takes actions that maximize its chance of successfully achieving its goals. These goals can be simple, or complex, can be explicitly stated or remain implicit in the problem, and they will usually depend on the task the AI is trying to solve.

At this point we need to make a distinction between AI and algorithms, and it may get a bit messy due to what is known as the “AI effect” which can be represented as follows: As soon as AI successfully solves a problem, the problem seems to no longer be a part of AI.

For example, when IBM’s chess playing computer Deep Blue succeeded in defeating Garry Kasparov in 1997, people complained that it had only used “brute force methods” and it wasn’t real intelligence. Fred Reed writes:

“A problem that proponents of AI regularly face is this: When we know how a machine does something ‘intelligent,’ it ceases to be regarded as intelligent. If I beat the world’s chess champion, I’d be regarded as highly bright.”

Fred Reed (2006–04–14) “Promise of AI not so bright”.

So let us back up; we have algorithms, which are a set of unambiguous instructions that a mechanical computer can execute, and that do not imply any use of “intelligence” because every set of possibilities have been considered, and every response to them has been hardcoded. This is how Deep Blue beat Garry Kasparov; every time the human player made a move the computer considered every possible move up until a certain depth, ranked them according to how likely they were to succeed and executed the move with the highest likelihood of giving the computer an advantage towards winning the game.

This is where a very interesting new concept comes in; “Machine learning”, which refers to the ability that AI has to “learn” new things. In the case of Deep Blue, unless changes were made to its code, the a priori chances of beating Kasparov the first time were the same as beating Kasparov after a thousand games, assuming that Kasparov’s level remained the same.

That is not the case anymore, the best chess AIs nowadays have the ability to learn every time they play, therefore, the initial algorithm tends to evolve to the point where the AI becomes a black box and its moves are unpredictable even for the people that have programmed it. With learning we refer to gaining the abilities to execute certain strategies that were not hardcoded when the AI was first released.

And here another closely related concept enters the picture, Big Data: data sets so big and complex that traditional data-processing application software are inadequate to deal with them. These data sets allow, for example, for an AI to examine and learn from every chess game ever recorded in a matter of hours.

So suddenly, if we mix AI with machine learning and big data, we end up with a domain specific intelligence that is many times more advanced than human intelligence. This combination has led to AIs performing many tasks, not just chess, much better than its human counterparts such as driving, face recognition, pattern recognition…

Everything seems to point towards a future where AI outperforms humans in every task, which starts to take us closer to the subject of this article; the implications that ethics will have for AI. Because even if machine learning allows machines to develop their own way of thinking, we can still hardcode a set of rules, or boundaries that the AI will never be able to break. The same way we can let a kid do anything he wants inside a sandbox except: 1) Exit the sandbox, 2) fight other kids, and 3) eat the sand; we can let AI do anything it wants, except for a set of rules that it is always obliged to abide.

In that respect, one of the most famous formulation was made by Isaac Asimov with the three laws of robotics, which we can easily make extensible to all AI:

- An AI may not injure a human being or, through inaction, allow a human being to come to harm.

- An AI must obey orders given it by human beings except where such orders would conflict with the First Law.

- An AI must protect its own existence as long as such protection does not conflict with the First or Second Law.

The original laws apply to just robots, but we are not sure what kind of container will AI have in the future. For example, movies such as 2001: A Space Odyssey or Her have showed more ethereal forms for sentient AIs.

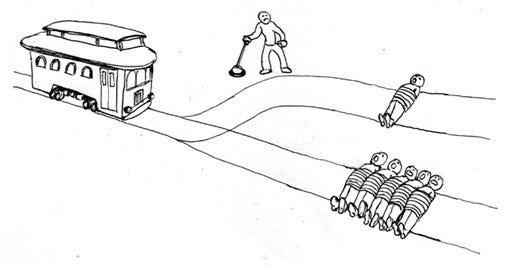

The problem with this laws is that there are some ethical problems were the AI in question has no choice but to break one of the laws, because it is forced to choose the least bad of two bad options. Probably the most illustrative of these problems is the Trolley Problem. The traditional thought experiment is presented as follows:

You see a runaway trolley moving toward five tied-up (or otherwise incapacitated) people lying on the tracks. You are standing next to a lever that controls a switch. If you pull the lever, the trolley will be redirected onto a side track and the five people on the main track will be saved. However, there is a single person lying on the side track. You have two choices:

1. Do nothing and allow the trolley to kill the five people on the main track.

2. Pull the lever, diverting the trolley onto the side track where it will kill one person.Which is the most ethical choice?

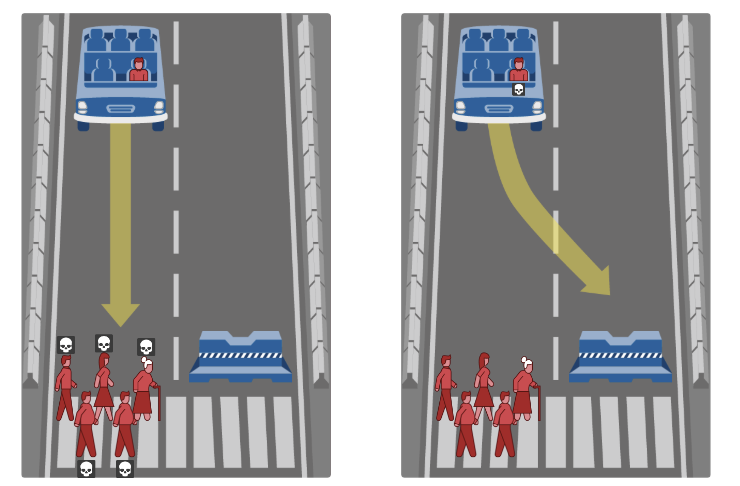

As you can see, this is a challenging situation which can be easily extensible to a self-driving car controlled by an AI. If the car is about to drive into a group of 5 and killed them all, should the AI steer the car and kill its passenger instead?

In this situation the computer must break Rule #1: An AI may not injure a human being or, through inaction, allow a human being to come to harm. His only options are either to injure the driver, or allow 5 people to come to harm through inaction.

Many possible solutions have been formulated for the Trolley Problem and its countless iterations, but, obviously, there is no definitive answer and I will leave it up to the reader to decide how she believes that the AI should be programmed. If you want to take the experiment a bit further, visit MIT’s great web page linked below the above image.

Another interesting angle is how AI seems to be more racist and sexist than human intelligence. When humans make decisions about hiring, or granting a bank loan, they’re more likely to be questioned about their judgement. But when it comes to AI, even if we were to try to guess what it based its decision on, we would be facing a black box; artificial neural networks just cannot explain their decisions.

We could try to mitigate this problem by telling the AI not to use racial data when granting loans, but there are many other correlated variables such as names (for example, in the United States, the last names Wei or DeShawn are highly correlated to Asian American and African American people respectively). Therefore, the AI could conclude the race and sex of the person using many proxy variables without ever taking into account those variables explicitly. And assuming that either race or sex are variables that determine the likelihood of, as an example, repayment of a loan, AIs would be more likely to deny loans or grant them in worse conditions based on racist or sexist biases.

A great article published on the award winning Canadian magazine, The Walrus, delves deeper into this problem:

“Let’s say we’re concerned about race as the factor of discrimination,” deep-learning pioneer Yoshua Bengio says. “Let’s say we see that, in our data, we can measure race.” Another constraint can be added to the neural network that compels it to ignore information about race, whether that information is implicit, like postal codes, or explicit. That approach can’t create total insensitivity to those protected features, Bengio adds, but it does a pretty good job.

The article adds:

A growing field of research, in fact, now looks to apply algorithmic solutions to the problems of algorithmic bias. This can involve running counterfactuals — having an algorithm analyze what might happen if a woman were approved for a loan, rather than simply combing through what’s happened in the past. It can mean adding constraints to an algorithm, ensuring that when it does make errors those errors are spread equally over every represented group. It’s possible to add a different constraint to the algorithm that lowers the threshold of, say, university acceptance for a particular group, guaranteeing that a representative percentage gets in — call it algorithmic affirmative action.

The problems mentioned above are just the tip of the iceberg, a small subset of issues we are currently facing. If we decide to think about the year 2100, after singularity and with sentient robots everywhere , the ethical problems become almost intractable from our current perspective:

- Should murdering a sentient robot be legally equated to murdering a human being?

- Is it morally correct to have robot slaves? What about sex slaves?

- Should we trust AIs if they are 99.99% sure that somebody was about to commit a crime, even if there are no conclusive evidence to support that accusation from a human intelligence perspective? This is the question that Philip K. Dick asks in the book The Minority Report.

- Should humans be allowed to marry AIs? Can AIs own assets? Should we let AIs decide who they belong to if its human owners get divorced?

All these questions make it obvious that philosophers, judges and ethics professors, among other experts, will become more relevant in the AI field. In the meantime, it is up to us to keep learning about AI to try to transition smoothly to the new world where AIs will be making most decision, and hope that we do not end up in a distopyan future such as the one in Alphaville, one of my favorite sci-fi movies.

The original question, 'Can machines think?' I believe to be too meaningless to deserve discussion.

- Alan Turing

El termino Inteligencia Artificial o I.A. aunque parece ser un tema de nuestro siglo, se ha estado trabajando desde el siglo pasado cuando se realizaron las platicas de Dartmouth en 1956 y ha sido pensado desde antes de eso más que nada en obras de ficción con nombres como "Frankenstein" por Mary Shelley por nombrar un ejemplo.

Pero si gente lleva más de medio siglo trabajando y pensando en esta rama de las ciencias computacionales, surgen algunas preguntas como: ¿ Qué es exactamente la I.A. ? ¿ Por qué hasta ahorita es cuando se ha estado generando más ruido acerca del tema ? , y la pregunta del millón de dólares creada por Hollywood ¿ Debería estar preocupado de que me quiten mi chamba? o aun más alarmante ¡¿ Se apoderarán del mundo como los robots en Terminator ?

... Antes de que se aceleren vámonos paso a paso por pregunta

¿ Que es I.A. ?

La Inteligencia Artificial es la rama de las ciencias computacionales que se enfoca en que una computadora haga cosas que ocupan inteligencia humana para realizarse. En el famoso libro "Artificial Intelligence: A Modern Approach" por Stuart J. Russell y Peter Norvig, los autores dan la definición de la inteligencia artificial en cuatro enfoques separados mostradas en una tabla que se mostrara a continuación:

Pensar HumanamentePara pensar como humano se ocupa saber como en verdad piensa un ser humano y aqui se incluye la parte de la ciencia cognitiva, la cual junta modelos de computadora con técnicas de la sicología para que la computadora observe a una persona y vea como piensa. |

Pensar RacionalmenteAqui se enfoca en la parte lógica de los humanos se incluyen unos pensamientos de filósofos griegos como Aristoteles. Pensamientos como: "Juan Carlos es un hombre; Todos los hombres son mortales; Por lo tanto , Juan Carlos es Mortal" Se espera que la I.A. piense racionalmente con lógica de acuerdo a la teoría que se ha desarrollado desde la Antigua Grecia. |

Actuar HumanamenteSe incluye la Prueba de Turing la cual fue hecha por Alan Turing y esta diseñada para diferenciar si el que la toma es una computadora o un humano. Esta incluye:

|

Actuar RacionalmenteSe dice que un "agente" es algo que actua y un "agente racional" es alguien que actua para llegar al mejor resultado. Se espera que la computadora actué de esta forma y de que "haga lo correcto" de acuerdo a su programación. |

Con estos cuatro enfoques nos podemos dar una idea de lo que es la Inteligencia Artificial, la que ha estado generando más ruido últimamente es la parte de actuar como un humano. Empresas como Google, Amazon, y Facebook se han estado enfocando en varias sub-categorías de la inteligencia artificial como Machine Learning, Procesadores del lenguaje, y Representación del conocimiento. Ejemplos incluyen el anuncio reciente de Duplex, un asistente creado por Google para facilitarte las reservaciones.

El tema de inteligencia artificial poco a poco empieza a emerger dentro de empresas importantes, pero la pregunta importante es ¿ Por qué ahorita es cuando empiezan a hablar de esto ?

¿Por qué ahora?

Se puede decir que el tema de la llegada de la I.A. es multifactorial y se platicarán dos temas que se consideran de los más importantes de el ¿ Por qué ahora ? Los factores son el avance que la humanidad ha tenido en lo computacional y en lo biológico.

Ray Kurzweil en su libro "The Singularity is Near" habla sobre Gordon Moore, co-fundador de Intel Corporation, y su ley la cual se llego a conocer como "la Ley de Moore". En esta habla sobre como cada año el número de transistores en un circuito incrementaba al doble manteniendo su costo fijo. Esto implicaba mucho mejor rendimiento y precios más baratos en los circuitos.

Como pueden ver en la imagen de arriba, esto causa un efecto exponencial en el poder de computo y nos acerca aun más a el poder de procesamiento de un cerebro humano.

No solo los avances en poder computacional son los que han puesto que la sociedad empiece a hablar sobre la I.A., también se tiene que considerar los avances en investigación de la rama de la biotecnología. Cada año se aprende algo nuevo de como funciona el cerebro humano y esto es lo que en alguna forma se busca llegar a recrear cuando se habla de la I.A. La evolución tanto biológica como tecnológica nos han permitido suponer y decir que la I.A. esta prácticamente a la vuelta de la esquina.

Las siguientes dos preguntas son meras especulaciones ya que aun no hay respuesta certera de lo que pasara. Pero se tomara una opinión con la información que se tiene al momento.

¿La I.A. me quitará mi trabajo?

Esta es una de las preguntas más frecuentes que salen al hablar de los avances en Inteligencia Artificial. Imagínense la situación en la que una computadora trabaja 24/7 con errores mínimos y no solo eso, si no que aprenderá a velocidades mucho más rápidas y estará consciente de corregir los defectos que se tiene al hacer su trabajo. Claro que cuando te lo pintan de esa manera surge el miedo en las personas. Hay que recordar que hoy en día hay un número muy alto de personas que dependemos de una computadora ( smartphones ) para llevar a cabo tu día. La colaboración del hombre y la máquina me hace imaginar un futuro en el cual los trabajos se hagan en conjunto con la Inteligencia Artificial . Un ejemplo que pasa hoy en día es el de los jugadores de ajedrez llamados "Centauros", estos son jugadores humanos colaborando con una computadora de muy alto nivel de procesamiento. Se obtiene la creatividad e intuición que se tiene con los humanos y el nivel de calculo y rapidez que se obtiene con una computadora para obtener una mezcla que puede vencer a cualquiera.

Otro punto importante cuando se habla del decremento de trabajos por la llegada de la I.A. es que aunque puede que muchos empleos queden obsoletos, otros nacerán de la nada. No olvidemos algunos trabajos que quedaron obsoletos por la llegada de la tecnología, por ejemplo antes existía el trabajo de tipógrafo y fue reemplazado por software de procesador de textos como Microsoft Word. A medida de que llegan avances tecnológicos muchos empleos dejan de existir, pero a la vez se crean nuevos trabajos en base a la necesidad que se tenga en ese momento.

¿Debería de estar asustado de la I.A.?

Si nos metemos más a fondo hay varias sub-categorías de inteligencia artificial dependiendo del grado o calibre del programa. Estos son ANI ( Artificial Narrow Intelligence o Soft A.I.), AGI ( Artificial General Intelligence o Strong A.I. ), y ASI ( Artificial Super Intelligence ). Hoy en día empresas han llegado a crear ANI, como ejemplos se puede decir que el buscador de Google o Siri de Apple son I.A. que se enfoca en un solo trabajo. Las otras dos ( AGI y ASI ) son las que no se ha podido llegar y las que se esta buscando llegar hoy en día. Estos dos tipos de I.A. son las que Hollywood ha recreado en películas como 2001: Una Odisea en el Espacio, la serie de Terminator, y I,Robot. Para evitar esos escenarios depende mucho de nosotros, primero que nada se debe buscar de donde recibe y de quien recibe la información la Inteligencia Artificial. Como ejemplo se tiene Tay.ai , un bot con I.A. de la empresa Microsoft que recibía información de los tweets que le mandaban. Este bot solo tardo un día en convertirse en racista gracias a los comentarios que le dejaban los usuarios de Twitter. Es necesario estar conscientes de la información que difamamos en el internet porque puede ser que en un futuro una computadora tome decisiones en base a eso.

https://giphy.com/gifs/adventure-time-computer-LtGbyZt3PFRZu

Nick Bostrom en su libro "Superintelligence" habla sobre la ASI, una super entidad tan inteligente que va a superar a humanos de maneras en las que no podemos comprender porque no somos tan listos para imaginarnos ese tipo de cosas. Es por eso que se deben de empezar a discutir normas y regulaciones en cuanto a la creación de este tipo de computadoras y prevenir desastres que puedan salir.

Y esto, ¿ A mi qué me importa ?

El tema de la Inteligencia Artificial esta aquí para quedarse. Aunque algunos expertos en el tema dicen que hay una probabilidad del 50% que pase para dentro de 20 años, hay otros expertos que dicen que nunca llegara. Las aplicaciones que se pueden llegar a tener en tu vida personal o laboral son inmensas. Poco a poco las empresas se ponen a cuestionar como lograrán implementar I.A. a sus procesos. Es importante estar al tanto de lo que pasa en el area porque este tipo de proyectos son los que cambian y transforman la humanidad en maneras que no podemos ni imaginarnos.

REFERENCIAS:

- Ray Kurzweil - The Singularity is Near

- Stuart J. Russell y Peter Norvig - Artificial Intelligence: A Modern Approach

- Nick Bostrom - Superintelligence

El término inteligencia artificial se vuelve cada vez más relevante. En la búsqueda de lo que realmente es IA, hay inmensos temas que me parecen importantes de analizar. En este post me enfocaré primero a lo que es IA, y después hablaré un poco (porque el tema es inmenso y podríamos ahondar muchísimo) a un tema que me parece extremadamente relevante, el uso positivo o negativo de la IA.

¿Qué es inteligencia artificial?

Generalizando un poco, el término IA actualmente nos lleva a pensar en máquinas y robots que pueden hacer cosas por nosotros, dejando de lado otras cosas que implican inteligencia artificial, desde tecnologías de traducción automática, aparatos inteligentes que usamos día a día, casas y ciudades inteligentes, entre otros.

Existen distintos tipos de inteligencia artificial:

- Artificial Narrow Intelligence (ANI). Aquella IA que se especializa solo en alguna tarea y no puede desarrollar otra tarea o análisis de data. Actualmente vivimos día a día con esta tecnología, por ejemplo, nuestros teléfonos inteligentes con mapas de navegación, Siri, también con nuestros autos, con parámetros específicos de inyección de combustible, o incluso redes como Facebook o Amazon, capaces de reunir y analizar información de tus preferencias para dar “recomendaciones que puedan interesarte”.

- Artificial General Intelligence (AGI). Aquella IA a la que nos referimos como Human-Level AI, como computadoras y/o máquinas que puedan desarrollar una actividad intelectual.

- Artificial Super Intelligence (ASI). Aquella IA que es más inteligente que el ser humano en varios campos, incluyendo creatividad científica, sabiduría general y habilidades sociales.

Es impresionante el desarrollo exponencial estos últimos años, y no nos hemos detenido a pensar realmente como la IA está cambiando y cambiará nuestro mundo en todos los sentidos, sobre todo en esta revolución digital que ha llevado a máquinas a conectar con el ser humano, conociendo gustos, preferencias y proveyendo información “adhoc”.

El uso de AI se vuelve extremadamente relevante en la propuesta de contenido distribuida digitalmente y la automatización del análisis de datos.

La cantidad de datos que producimos se duplica cada año. En 2016 produjimos tantos datos como en toda la historia de la humanidad hasta 2015. Cada minuto producimos cientos de miles de búsquedas de Google y publicaciones en Facebook. Estos contienen información que revela cómo pensamos y sentimos. Pronto, las cosas que nos rodean, posiblemente incluso nuestra ropa, también estarán conectadas con internet, (Helbing, 2017).

Hoy en día, los algoritmos saben muy bien lo que hacemos, lo que pensamos y cómo nos sentimos, posiblemente incluso mejor que nuestros amigos y familiares, o incluso a nosotros mismos, (Helbing, 2017).

En la búsqueda de aprender más de lo que es y su uso, dejamos de lado el reconocimiento de las aplicaciones negativas y positivas; y en caso de las aplicaciones negativas, cómo podemos pre venirlas y/o remediarlas.

¿A qué tipo de aplicaciones negativas o positivas me refiero?

Hay muchísimos, pero hablaré de cómo los algoritmos de búsqueda y los sistemas de recomendación pueden verse influenciados, y cómo pueden afectar el rumbo de la sociedad.

Las empresas pueden pujar por ciertas combinaciones de palabras para obtener resultados más favorables. Los gobiernos probablemente también puedan influir en los resultados. Durante las elecciones, pueden empujar a los votantes indecisos a apoyarlos, una manipulación que sería difícil de detectar. Por lo tanto, quienquiera que controle esta tecnología puede ganar las elecciones empujándose al poder, (Helbing, 2017).

Esta semana observé un video de “Conoce al rey de las fake news en México”. Dentro de la entrevista, hablan de cómo la mayoría de los trending topics de México son escritas por personas falsas en agencias de marketing, y su comienzo de “manipulación digital en 1999-2000”.

Ni siquiera sé qué tan real es todo el contenido del video, pero me preocupa. Es impresionante como los algoritmos pueden influenciar, como la creación de bots y ciber-delincuencia pueden manipular el destino de un país.

Como menciona Dirk Helbing en su artículo “Will Democracy Survive Big Data and Artificial Intelligence?”, para que la manipulación no se note, se necesita un llamado efecto de resonancia, sugerencias que son lo suficientemente personalizadas para cada individuo. De esta manera, las tendencias locales se refuerzan gradualmente mediante la repetición, conduciendo hasta la "burbuja de filtro" o el "efecto de cámara de eco": al final, todo lo recibido parece un reflejo de nuestras propias opiniones.

En el artículo de “preparing for malicious uses of AI”, Clark, Page y Amodei mencionan una investigación que está interesante (la dejo en las referencias). Esta investigación trata sobre cómo la IA desafía la seguridad global, crea nuevas amenazas y complica la atribución de ataques específicos, y muestran un reporte con recomendaciones de alto nivel para compañías, organizaciones de investigación, profesionales individuales y gobierno para garantizar un mundo más seguro. Es importante mencionar que esta investigación va más allá del tema antes mencionado, pero hacen enfoque a algunas prácticas que considero relevante para muchas organizaciones independientemente de la industria. Las menciono a continuación:

- Reconocer la naturaleza de doble uso de IA. IA es una tecnología capaz de aplicaciones inmensamente positivas e inmensamente negativas. Los gobiernos y los actores privados tendrán acceso a muchas de estas herramientas de inteligencia artificial y podrían usarlas para bien o daño público. Algunas posibles soluciones a estos problemas incluyen evaluaciones de riesgo previas a la publicación para ciertas partes de cada investigación, compartiendo selectivamente algunos tipos de investigación con un componente de seguridad significativo entre un pequeño conjunto de organizaciones de confianza.

- Aprender de seguridad cibernética. Existen diversas prácticas que son relevantes para los investigadores de IA y se podrían implementar en otras investigaciones. Van desde invertir en pronósticos tecnológicos para detectar amenazas, a convenciones de informes y más.

- Ampliar la discusión. AI va a alterar el panorama global de las amenazas, por lo que se debería involucrar a la sociedad en discusiones transversales. Podrían incluir sociedad civil, expertos en seguridad nacional, empresas, especialistas en ética, público en general y otros investigadores.

Como vemos, el tema de inteligencia artificial es muy amplio, pero es importante comenzar a darle la relevancia necesaria en cada ámbito, desde utilizarlo en empresas para optimizar procesos, hasta comprender el doble uso que podría dársele y canalizarlo de la mejor manera para la sociedad.

Bibliografía:

https://waitbutwhy.com/2015/01/artificial-intelligence-revolution-1.html

https://www.bsfrey.ch/articles/D_283_2017.pdf

https://blog.openai.com/preparing-for-malicious-uses-of-ai/

https://arxiv.org/pdf/1802.07228.pdf

[Referencia]

[Referencia]